Es indudable que hoy en día el crecimiento de desarrollos mediante la inteligencia artificial es exponencial. Nos encontramos ante una revolución de creación tecnológica que ampliará nuestras capacidades y desarrollos innovadores. El uso de las técnicas de algoritmos avanzados, inteligencia artificial, machine learning y deep learning crean horizontes nuevos en el uso de la tecnología y posteriores soluciones de progreso de y para la sociedad. Pero todas estas técnicas tienen un elemento común, son vulnerables al alma del creador. Tienen subjetividad humana en la manera de usar los algoritmos y las aproximaciones numéricas a la resolución de problemas. Todo esto, y un poquito más, es lo que denominamos, el sesgo en la inteligencia artificial.

Para poder empezar a definir las razones e implicaciones del sesgo en la inteligencia artificial tenemos que comprender cómo se define etimológicamente el concepto de sesgo. Según la RAE, dentro de sus varias acepciones (me quedo con las 2 que considero más adecuadas para este contexto), se define sesgo como algo que está torcido, cortado o situado oblicuamente y un error sistemático en el que se puede incurrir cuando al hacer muestreos o ensayos se seleccionan o favorecen unas respuestas frente a otras.

La mente del ser humano aplica por su propia naturaleza un sesgo implícito. Si bien nuestro cerebro tiene un enfoque ético y de razonamiento abstracto la capacidad inherente de identificación de patrones para la mente humana se basa en la experiencia y la capacidad relacional. Es por esta causa por la que, si no lo hemos vivido, sentido, imaginado o no lo podemos relacionar…simplemente, no existe.

“Juzgar los hechos amargos con sesgo optimista equivale a no habernos enterado debidamente de ellos. “— José Ortega Y Gasset.

Algo parecido pasa con los sistemas de inteligencia artificial y de aprendizaje automático. Se alimentan de datos y patrones relacionales por lo que, si en los datos de aprendizaje, se encuentran sesgos, la capacidad cognitiva contará con ellos. Además, es inherente al propio sistema algorítmico, matemático o relacional el que puedan existir sesgos a la hora de aplicar la propia metodología de cálculo e interpretación. Estas técnicas se basan en el uso y clasificación de los datos. De manera sencilla, podemos decir, que “enseñamos” a la Inteligencia Artificial mediante datos e informaciones lo que es cada cosa. Ya estamos clasificando directamente mediante los conjuntos de aprendizaje. Es obvio, que en este modelo de aprendizaje cabe sesgo en la clasificación o simplemente ausencias en el conjunto de los datos de entrenamiento y validación. Así se crea uno de los sesgos más importantes y a los que son vulnerables los sistemas de Inteligencia Artificial.

Es por todo esto, que el sesgo, o a la ausencia de muestra real o total, siempre estará presente, pero, además, podemos aumentarlo al tratar la información con el “prejuicio” matemático o algorítmico de su creador.

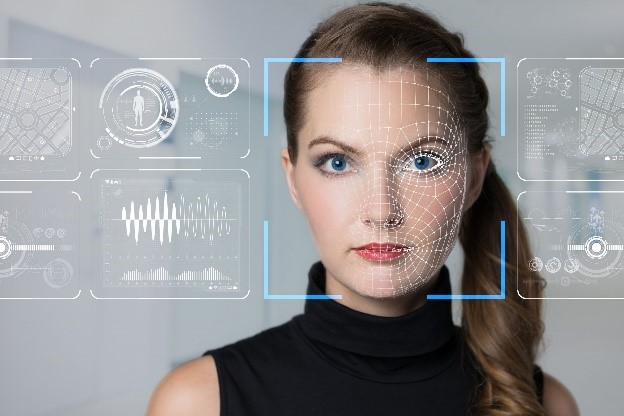

Hoy en día existen sesgos importantes en los sistemas de reconocimiento facial y vocal, aunque se están desarrollando grandes estudios e implementaciones para mitigar el impacto. Esto no es más que un ejemplo sencillo, pero puede darnos una idea de lo importante que puede ser que el sesgo haga que un sistema de reconocimiento facial o vocal nos identifique de manera errónea o que simplemente no nos identifique. Existe un concepto llamado “democratización de la inteligencia artificial”, promulgado por Jennifer Belissent, que de manera resumida explica la gran necesidad de tener sistemas de big data (de casi todo) para combatir los posibles sesgos en los datos de entrada a los sistemas de inteligencia artificial.

Se han hecho varios ensayos y estudios sobre fallos en los sistemas de reconocimiento facial más importantes, como por ejemplo CamFind y Rekognition, dónde, según los estudios presentados se observaban sesgos en la clasificación racial y de género. Otro sesgo que se ha detectado en una famosa base de datos (ImageNet) es el de la prevalencia de imágenes e información relacionada con el hemisferio norte, motivo claro, por el que se puede observar ese sesgo en el sistema de clasificación, patronaje y relacional.

La tipología de los sesgos que puedan afectar a los sistemas de inteligencia artificial y aprendizaje automático son muchos, y sus clasificaciones variadas. Muchas veces se pueden llegar a identificar por el impacto que generan o por el ámbito de colección de los datos de origen. Unos ejemplos de tipos de sesgos, sin entrar en detalle ni clasificarlos pueden ser; raciales, de género, geográficos, edad, de medición, de muestra, de clasificación, de estereotipo, de confirmación, de distribución, de supervivencia, de automatización, social, interacción, … y muchos más que hacen que estos sistemas tan importantes para nosotros hoy en día sean vulnerables a la definición de sesgo.

Sin ánimo de crear un debate y con la intención de reflejar un hecho, Bixby, Siri, Alexa, Cortana, son asistentes vocales que conviven con nosotros en nuestros dispositivos más usuales y tienen nombres y una voz femeninos por defecto… no voy a dar razones, lo dejo para la intuición e interpretación del lector.

Además de la antes mencionada, democratización del dato, hay una potencial solución para ir eliminando el sesgo de los sistemas de aprendizaje automático e inteligencia artificial, la validación total de los resultados. Es una premisa ideal, pero verificar cada una de las salidas del sistema, relacionarla con las entradas que motivaron la decisión y evaluar el acierto final está bastante claro que es una de las líneas de eliminación del sesgo. No cabe duda de que es muy complejo, difícil de implementar y en algunos casos imposible de validar, pero empiezan a existir técnicas que incluyen esta verificación del resultado en el propio algoritmo y en los conjuntos de datos. Existen otras iniciativas para luchar contra el sesgo, como algunas relacionadas con un prechequeo de los datos que alimentan los modelos que detecten potenciales sesgos de origen y poderlos eliminar o minimizar antes de que los algoritmos trabajen con ellos. Es un problema detectado, pero en el que los desarrolladores de IA ya están trabajando para que se mejoren los modelos y sistemas día a día.

El sesgo y su identificación es una medida ética a desarrollar y solventar para que pueda convivir el ser humano con el transhumanismo detrás de la tecnología.

“El verdadero progreso es el que pone la tecnología al alcance de todos. “— Henry Ford

2 respuestas

Excelente artículo. Hace tiempo escribí sobre el uso de la Inteligencia Artificial para la toma de decisiones en este artículo de mi blog MyTips: https://www.mytips.es/inteligencia-artificial-para-la-toma-de-decisiones/, enlazaré esta entrada.

Conociendo un poco acerca de cómo funcionan estos sistemas, podemos darnos cuenta de cómo podemos estar utilizando algoritmos sesgados sin darnos cuenta (os recomiendo este otro artículo https://www.mytips.es/nociones-sobre-inteligencia-artificial/)

Está claro que no podemos confiar ciegamente en los algoritmos y que para elaborarlos son necesarios no solo expertos en las técnicas de la IA, también expertos en el campo donde ésta se pretende aplicar y en otras materias (derecho, ética, etc) porque podríamos correr el riesgo de automatizar las injusticias.

El sesgo no es nunca deseable ya que supone una falta de objetividad. El problema es que es muy difícil de evitar porque, en muchas ocasiones, es inconsciente. En nuestro día a día todos tenemos ciertos sesgos a la hora de valorar tanto las informaciones de prensa como cualquier evento de la realidad.

El tema es qué metodología se debe emplear en la IA para disminuir el sesgo lo más posible